Když tě znají, navždy tě již rozpoznajíVýzkumníci z Texaské univerzity v Austinu a Cornellovy univerzity zjistili, že bez ohledu na to, nakolik pixelizujete či rozmazáváte svůj obličej či text na obrázku, nástroje umělé inteligence ho s největší pravděpodobností rozpoznají. Tedy pokud ho už ve své databázi. Máme se čeho bát?

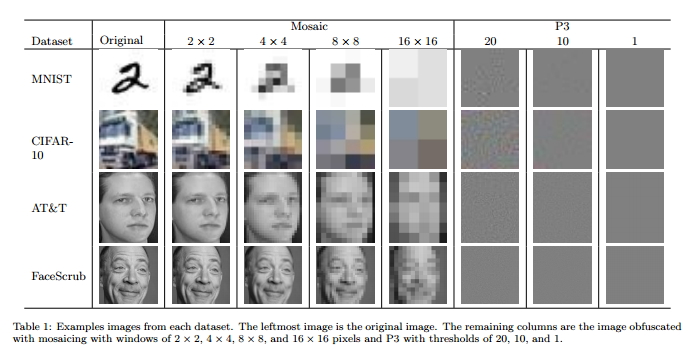

Richard McPherson, Reza Shokri a Vitaly Shmatikov se ve své práci Defeating Image Obfuscation with Deep Learning zabývají způsoby, jakými lze naučit nástroje umělé inteligence rozpoznat obrázky a ručně psané znaky, i když pozměněny tak, aby byly k nepoznání. Sami říkají: „Demonstrujeme fakt, že moderní metody rozpoznávání založené na umělých neuronových sítích dokáží extrahovat z obrázků informace ukryté nejrůznějšími způsoby. Konkrétně se ve své studii zabýváme způsoby ukrytí známými jako mozaika (aka pixelizace), rozmazání (v podobě, v jaké se užívá na YouTube) a P3 (nedávno navržený systém pro zachování soukromí, který šifruje JPEG tak, aby nebyl rozpoznatelný pro lidské jedince). Empiricky ukazujeme, jak trénovat umělou neuronovou síť, aby byla schopna rozpoznat tváře, ručně psané znaky a objekty, i když jsou chráněny některou ze zmíněných technik.“ V rámci experimentu použili databáze fotografií pro strojové učení MNIST, CIFAR-10, AT&T a FaceScrub. Každá fotka byla pozměněna sedmi způsoby (i poslední tři sloupce na obrázku reprezentují originální fotku pozměněnou systémem šifrování P3). Umělá inteligence se pak učila, jak se produkovaný obraz mění v závislosti na použití obfuskační metody (způsobu znepřístupnění). Posléze byly neuronové síti prezentovány stejně pozměněné fotografie. Šlo o jiné fotografie než v učebním vzorku, jejichž originál ovšem měla síť k dispozici v podobě databáze. A zjišťovala se úspěšnost takového rozpoznání. Tam, kde lidé dosahovali lidé úspěšnosti rozpoznání 0,19 %, dokázala umělá inteligence úspěšně skórovat v 71 % případů na poprvé a v 83 % případů, pokud měla na tip pět pokusů. Naučený algoritmus se přitom nesnažil obnovit původní fotku, prostě jen obfuskací deformované objekty přiřazoval k fotkám, kterými disponoval. I když právě tato dispozice fotografií nechává mnohé v klidu, každý správný paranoik ví, že stroje hromadné ho sběru dat dokáží naplnit neuvěřitelně obsáhlé databáze. Další nástroje umí spárovat fotky ze sociálních sítí s reálnou identitou člověka (viz kauza FindFace a ruské sítě VK.com), záběry kamer relativně neškodných i těch, které asistují při autentizaci procházejících (jako například na letišti) a mnohé další data. Tak snadno nejen identifikují konkrétního jedince, ale i jeho pohyb v dosahu elektronických technologii. Jediné, co je potřeba, je dostatečný výpočetní výkon. Shmatikov uzavírá: „V oblasti bezpečnosti a ochrany soukromí lidé plně nedoceňují sílu strojového učení. A dokud jim někdo neukáže, že i relativně běžně dostupná technologie se dá použít k narušování soukromí, nebudou schopni si to uvědomit.“ Zdroje: MCPHERSON, R.; SHOKRI, R.; SHMATIKOV, V. Defeating Image Obfuscation with Deep Learning [PDF], Quartz

Daniel Beránek, 13.09.2016 14:07 Český software Zoner Photo Studio X přichází s jarní aktualizací, která posouvá hranice fotoeditace na novou úroveň. Díky pokročilým AI nástrojům a dalším inovacím je práce s fotografiemi rychlejší, preciznější... Francouzští vývojáři Mistral, známí svou láskou k open-source, přichází s novým AI modelem Mistral Small 3. S 24 miliardami parametrů je sice menší než konkurenční obři, zato však nabízí rychlost, nízké... Nové AI modely DeepSeek R1 a Qwen2.5-Max představují dva odlišné přístupy k tréninku a provozním nárokům, které by mohly zásadně ovlivnit budoucí vývoj umělé inteligence. Zatímco DeepSeek R1 se profiluje jako model postavený na... Grok, umělý inteligentní asistent od společnosti xAI, udělal další krok na cestě k větší dostupnosti. Coby samostatná aplikace se šíří na další platformy. Co Grok nabídne, kde ho již můžeme vyzkoušet a co teprve přijde?

... |